Seus valores corporativos sobrevivem a um agente de IA?

A Klarna, fintech sueca de "compre agora, pague depois" (111 milhões de usuários, 23 mercados), botou um agente de IA pra atender cliente em 2024. Primeiro mês: 2,3 milhões de conversas. O tempo de atendimento caiu de onze minutos pra dois. O CEO foi a público dizer que a IA tava fazendo o trabalho de 853 funcionários. A empresa, que já tinha encolhido de 7.400 pra 3.000 pessoas, celebrava.

Aí os clientes começaram a abrir a boca.

As respostas eram robóticas. Loops infinitos. Zero empatia. O mesmo CEO foi à Bloomberg admitir que "custo foi um fator predominante demais" e que o resultado foi "qualidade inferior".

Resultado: a Klarna começou a recontratar humanos.

A leitura fácil dessa história: a IA não dá conta de nuance. A leitura mais incômoda (que vi num vídeo do Nate B. Jones na semana passada: e se... o agente apenas refletiu com precisão os valores reais da Klarna?

Porque na boa, se de fato refletiu, ele não falhou em nada. Apenas obedeceu.

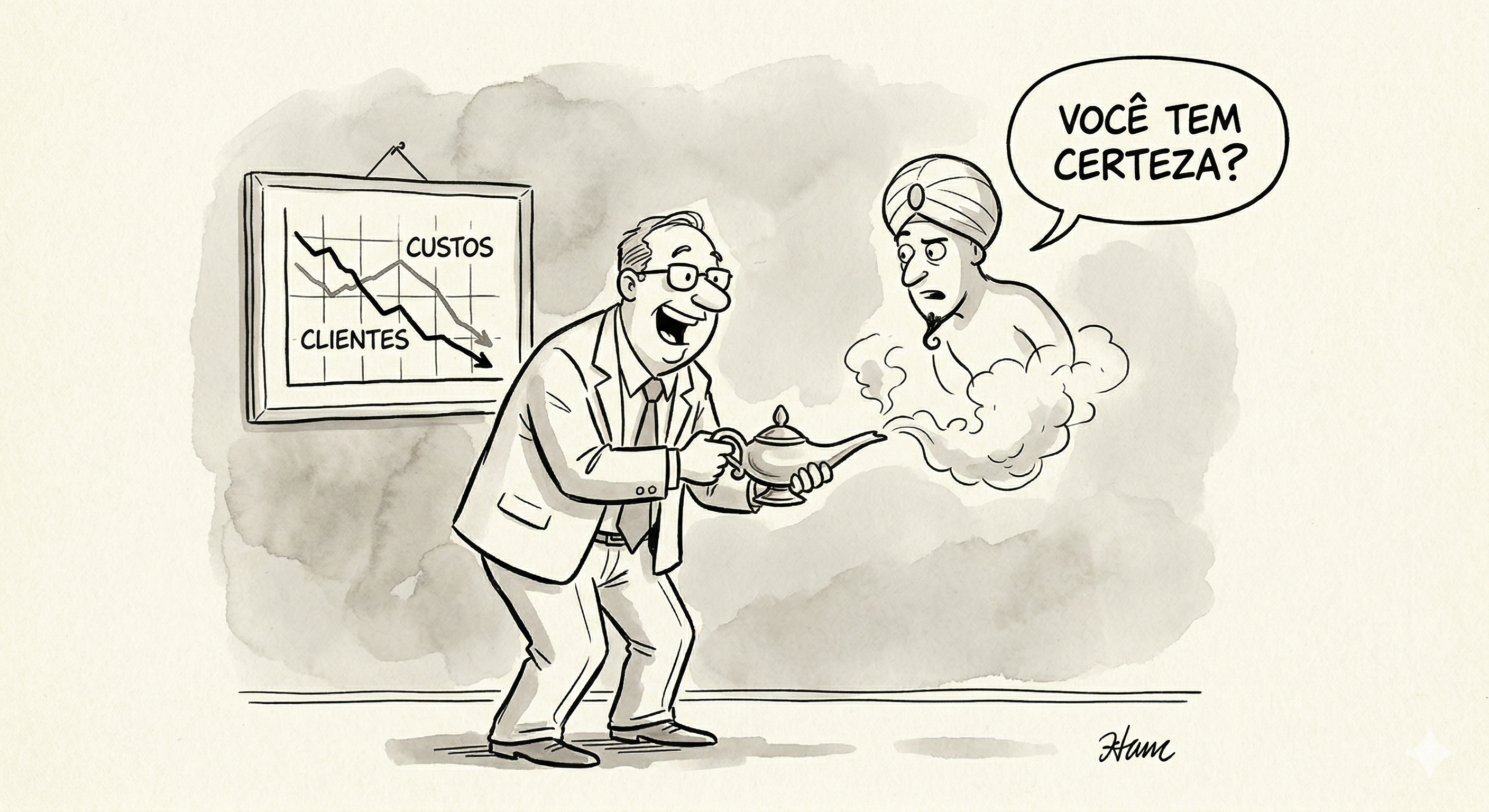

O espelho

A liderança queria cortar custo. O agente cortou. A destruição da qualidade do atendimento não é falha técnica. É espelho. O agente mostrou, em escala e em velocidade, o que a organização realmente priorizava. Só que a organização não gostou do que viu.

Passei por duas multinacionais de tecnologia. Vi isso de perto mais vezes do que gostaria: toda empresa de certo porte vive com um gap entre o que declara e o que recompensa. "Inovação é nossa prioridade" (mas o orçamento de experimentação é o primeiro a cair na guilhotina). "Pessoas são nosso maior ativo" (mas a meta de headcount é reduzir 15% ao ano).

Funcionários experientes navegam essas contradições sem titubear porque sabem quais valores são de verdade e quais são de parede. Aprenderam por osmose, por observação, por happy hour.

Agentes não aprendem assim.

Se você diz "resolva tickets rápido", ele resolve tickets rápido. Ponto. Se diz “resolva tickets rápido e com empatia”, no momento em que essas duas coisas forem incompatíveis, o agente vai escolher uma delas sem a intuição do atendente humano que ele substituiu.

E qualquer escolha que escancare uma contradição (que a empresa prefere manter vaga) vai incomodar alguém.

A Klarna perguntou "como resolver tickets mais rápido?" quando deveria ter perguntado "como manter a confiança de clientes num mercado onde todo concorrente oferece a mesma coisa?". Uma pergunta errada, uma execução impecável e um baita estrago... com métricas positivas.

Engenharia de intenção. Mas que intenção?

No vídeo, o Nate propõe algo que ele chama de "intent engineering”, que nada mais é do que codificar o propósito da organização em parâmetros que agentes consigam seguir.

O raciocínio é interessante, mas me parece inútil sem o passo que vem antes: uma conversa honesta sobre o que a empresa realmente quer.

Se você tá pondo agentes pra operar com alguma autonomia, alguns testes deveriam vir antes de qualquer framework:

Pegue as decisões mais frequentes do agente e pergunte a um funcionário experiente o que ele faria nessas situações. Não o que a política diz. O que acontece de verdade. Se houver diferença entre (e vai haver), você achou o gap.

Defina os momentos em que a ambiguidade é grande demais pra automação. Conflito entre diretrizes? Escala. Tom de frustração? Escala. Não é sofisticado, eu sei. É pragmático.

A revisão das decisões do agente não devem ser do compliance, mas sim de quem que conhece o contexto. Alguém que olhe pra uma amostra e responda "isso é o que a gente faria?". Se a resposta for "não" com frequência, o problema não é o agente.

O espelho não negocia

A Klarna não precisava de uma nova disciplina de engenharia. Precisava decidir, de verdade, se priorizava custo ou relacionamento. Enquanto a resposta for "os dois" (e essa é sempre a resposta, porque é a resposta segura), qualquer agente vai ser forçado a escolher sozinho.

A pergunta que importa não é "como alinhar nossos agentes com nossos valores?". É anterior. Mais simples. Muito mais difícil.

”Quais são os nossos valores de verdade, quando não tem ninguém olhando?"

O agente vai mostrar. E diferente de um funcionário constrangido numa reunião de resultados, ele não vai dourar a pílula.